Mục lục:

- Tác giả John Day day@howwhatproduce.com.

- Public 2024-01-30 13:31.

- Sửa đổi lần cuối 2025-01-23 15:15.

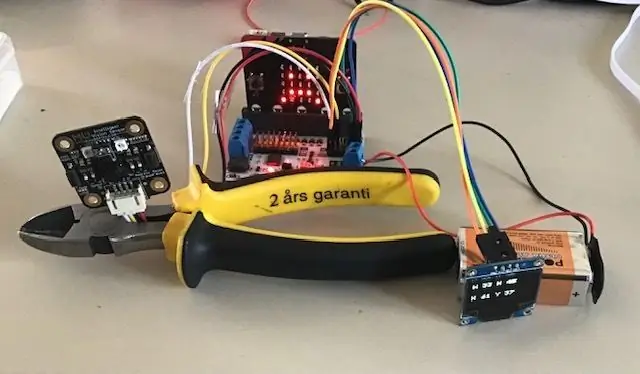

Đây là hướng dẫn thứ tư của tôi về cảm biến tầm nhìn MU cho micro: bit. Ở đây tôi sẽ giới thiệu cho các bạn cách theo dõi các đối tượng bằng micro: bit và ghi tọa độ vào màn hình OLED. Trong các hướng dẫn khác của tôi, tôi đã hướng dẫn cách kết nối micro: bit với cảm biến thị giác MU và OLED và cách lấy phần mở rộng phù hợp để lập trình nó. Tôi vẫn sẽ giải thích điều đó trong hướng dẫn này, nhưng nhanh hơn một chút.

Quân nhu

1 x BBC vi mô: bit

1 x Morpx Mu Vision Sensor 3

1 x Micro: bảng đột phá bit - Nó cần có quyền truy cập vào chân 19 & 20, điều mà không phải bảng đột phá nào cũng có. Tôi sử dụng motorbit elecfreaks, vì tôi thích bảng đó.

8 x dây Jumper (Nữ-Nữ)

1 x màn hình OLED

Bước 1: Bước 1: Thiết lập cảm biến

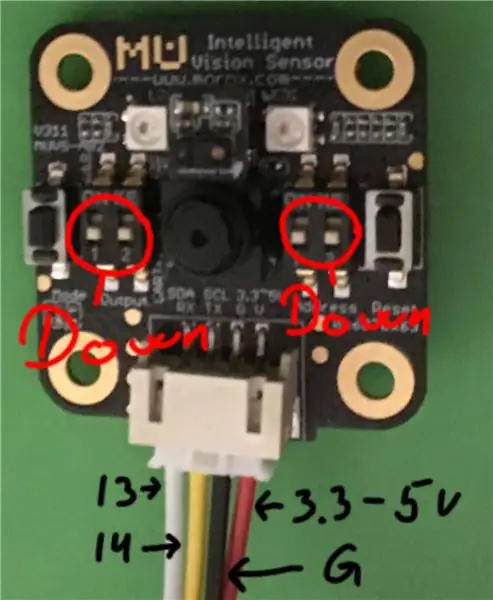

Trước khi bắt đầu kết nối bất cứ thứ gì, chúng tôi muốn thiết lập cảm biến đúng cách.

Cảm biến Mu Vision có 4 công tắc. Hai cái bên trái quyết định chế độ đầu ra của nó và hai cái bên phải quyết định địa chỉ của nó. Vì chúng tôi muốn địa chỉ là 00, nên tắt cả hai công tắc ở bên phải. Các chế độ đầu ra khác nhau là:

00 UART

01 I2C

10 quyền truy cập dữ liệu Wi-Fi

11 Truyền hình ảnh qua Wifi

Chúng tôi muốn sử dụng kết nối nối tiếp, vì màn hình OLED cần các chân micro: bit chỉ I2C, vì vậy chúng tôi sẽ làm việc ở chế độ UART. Điều đó có nghĩa là hai công tắc sẽ ở trạng thái 00, vì vậy cả hai công tắc sẽ được bật.

Bước 2: Bước 2: Đấu dây

Việc đấu dây khá dễ dàng, chỉ cần sử dụng bốn dây jumper để kết nối cảm biến Mu với bảng đột phá của chúng tôi. Nhìn vào hình ảnh trong Bước 1 để được trợ giúp.

Cảm biến Mu -> Bảng đột phá

RX-> chân 13

TX -> chân 14

G -> Mặt đất

V -> 3,3-5V

Sau đó, chúng tôi sử dụng bốn dây jumper để kết nối OLED với bảng đột phá của chúng tôi.

OLED -> Bảng đột phá

Vin -> 3,3 v

GND -> GND

SCL -> Pin19

SCD -> Pin20

Bước 3: Lấy các tiện ích mở rộng

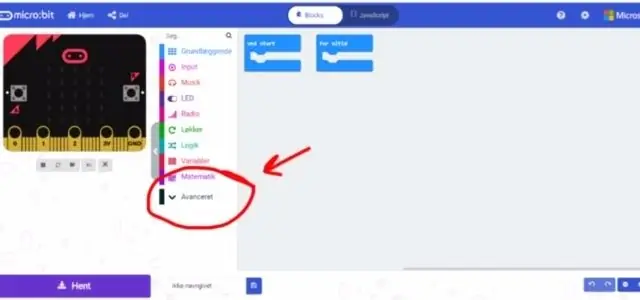

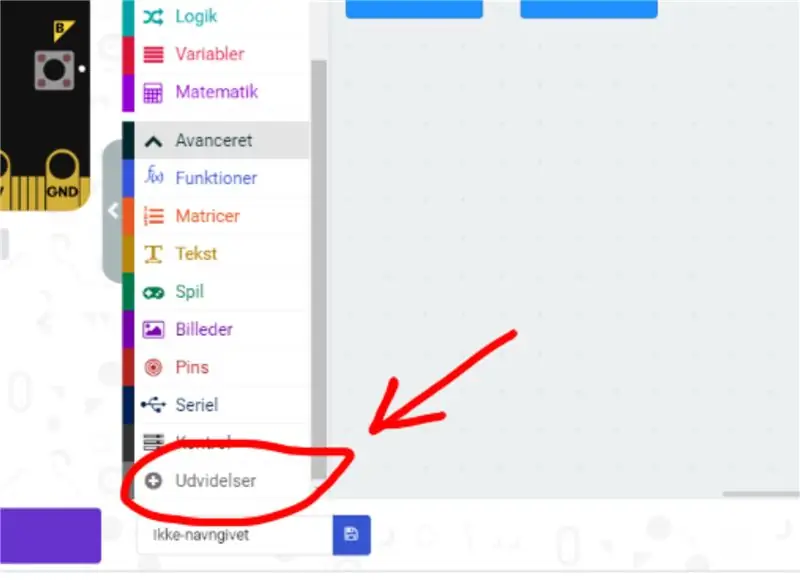

Đầu tiên chúng ta vào trình soạn thảo Makecode và bắt đầu một dự án mới. Sau đó chúng ta vào "Nâng cao" và chọn "Tiện ích mở rộng". Cần biết rằng vì tôi là người Đan Mạch nên các nút này có tên hơi khác trong hình. Trong các tiện ích mở rộng, chúng tôi tìm kiếm "Muvision" và chọn kết quả duy nhất mà chúng tôi nhận được. Sau đó, chúng tôi quay lại phần mở rộng và tìm kiếm oled12864 và chọn phần mở rộng OLED12864_I2C.

Bước 4: Coding- on Start

Khối đầu tiên trong chương trình này cho micro: bit biết nó sẽ sử dụng chân nào để tạo kết nối nối tiếp. Nếu bạn đã sử dụng các chân giống như tôi khi kết nối cảm biến tầm nhìn MU, thì bạn muốn đặt TX thành chân 13 và RX thành chân 14. Tốc độ truyền, đó là tốc độ mà cảm biến tầm nhìn micro: bit và MU sẽ nói, nên được đặt thành 9600.

Khối tiếp theo khởi tạo kết nối I2C giữa màn hình OLED và Micro: bit. Địa chỉ phụ thuộc vào phần cứng OLED. Nó thường là 60, nhưng đối với một số màn hình OLED, nó có thể là 61 hoặc các con số khác.

Tôi bao gồm ba khối số hiển thị để giúp khắc phục sự cố. Ví dụ: nếu micro: bit chỉ đếm đến 2 khi khởi động, thì tôi biết có vấn đề khi bật thuật toán thẻ hình dạng. Bạn có thể bao gồm khối số hiển thị thứ tư đặt cược với khối thứ nhất và thứ hai trong chương trình hiện tại.

Khối tiếp theo, khối màu cam đầu tiên, khởi tạo kết nối nối tiếp giữa cảm biến tầm nhìn MU và micro: bit.

Khối tiếp theo là khối hiển thị số để khắc phục sự cố.

Khối tiếp theo, sẽ là khối màu cam thứ hai, yêu cầu cảm biến MU kích hoạt các thuật toán Thẻ hình dạng.

Khối cuối cùng là khối hiển thị số để khắc phục sự cố.

Bước 5: Mã hóa - Vòng lặp mãi mãi

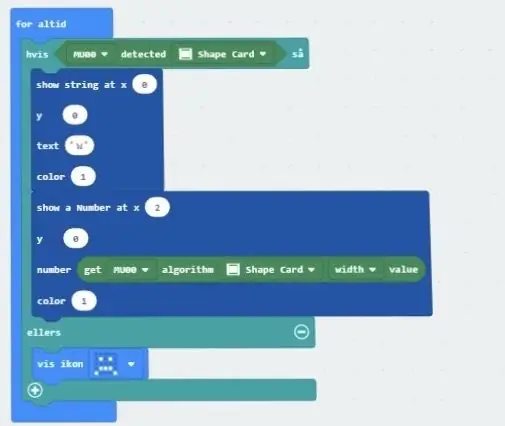

Chúng tôi bắt đầu chương trình với một khối if-else, với một khối thẻ hình dạng deteck.

Thẻ hình dạng phát hiện đưa ra 0 hoặc 1. Nếu thẻ hình dạng được phát hiện, chúng tôi nhận được 1 (đúng) và 0 (sai) nếu thẻ số không được phát hiện. Chúng tôi cần bao gồm điều đó, bởi vì với thẻ hình dạng, các thuật toán của chúng tôi sẽ luôn chạy trên các thẻ hình dạng được phát hiện cuối cùng. Vì vậy, nếu chúng tôi không bao giờ phát hiện một shapecard, thì chúng tôi không thể thực sự chạy các thuật toán.

Khối đầu tiên trong tuyên bố sự thật yêu cầu màn hình OLED viết chữ W (Cho chiều rộng) ở góc trên cùng bên trái của màn hình. Vị trí (0, 0).

Khối tiếp theo yêu cầu màn hình OLED ghi số mà nó nhận được từ thẻ hình dạng theo thuật toán bên phải của W. Vị trí (2, 0). Con số này cho chúng ta biết chiều rộng của thẻ hình dạng.

Chương trình tiếp tục như thế này.

Đầu tiên là một khối yêu cầu màn hình OLED viết một chữ cái. H cho Chiều cao tại (5, 0). X cho giá trị vị trí X tại (0, 2). Y cho giá trị vị trí Y tại (5, 2)

Sau đó, một khối thứ hai yêu cầu màn hình OLED viết một số mà nó nhận được từ thuật toán thẻ hình dạng. Chiều cao của thẻ ở (7, 0). Các thẻ X-vị trí tại (2, 2). Các thẻ Y-vị trí tại (7, 2).

Vì vậy, khi chúng tôi chạy chương trình và cảm biến MU Vision phát hiện một biểu đồ, nó sẽ cung cấp cho chúng tôi chiều rộng, chiều cao và vị trí của thẻ.

Toàn bộ chương trình có thể được tìm thấy ở đây.

Bước 6: Kiểm tra

Có thể hơi khó để xem trên video, nhưng khi tôi di chuyển thẻ từ bên này sang bên kia, giá trị X sẽ thay đổi. Di chuyển thẻ lên và xuống sẽ thay đổi giá trị Y. Di chuyển thẻ đến gần và ra xa cảm biến tầm nhìn MU sẽ thay đổi các giá trị chiều cao và chiều rộng.

Nó là khá dễ dàng để sử dụng chương trình này để phát hiện những thứ khác. Chỉ cần thay đổi "thẻ hình dạng" thành những gì bạn muốn phát hiện. Nó sẽ hoạt động với các khối màu, quả bóng, cơ thể, thẻ số và thẻ giao thông.

Đề xuất:

Lập trình hướng đối tượng: Tạo đối tượng Học / Phương pháp giảng dạy / Kỹ thuật sử dụng Shape Puncher: 5 bước

Lập trình hướng đối tượng: Tạo đối tượng Phương pháp học / dạy / kỹ thuật sử dụng Shape Puncher: Phương pháp học / dạy dành cho sinh viên mới làm quen với lập trình hướng đối tượng. Đây là một cách cho phép họ hình dung và xem quá trình tạo các đối tượng từ các lớp. Cú đấm lớn 2 inch của EkTools; hình dạng rắn là tốt nhất.2. Mảnh giấy hoặc c

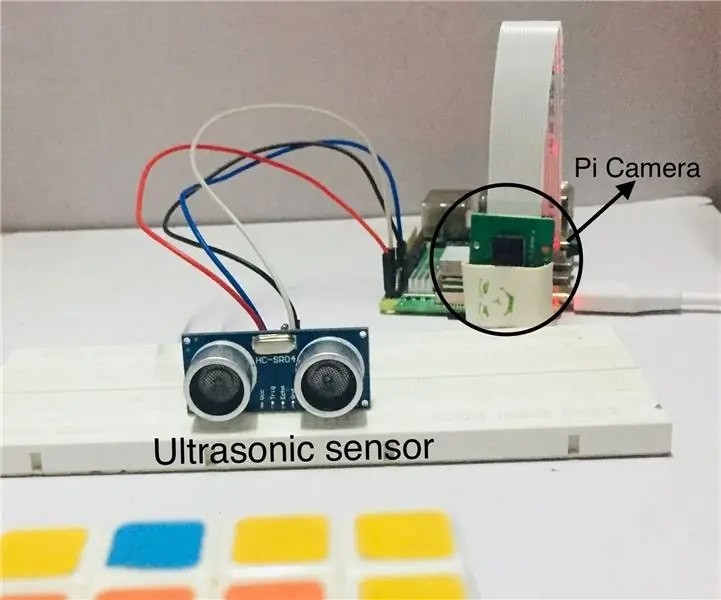

Cảm biến siêu âm để nắm bắt các thay đổi vị trí của đối tượng: 3 bước

Cảm biến siêu âm để nắm bắt các thay đổi vị trí của đối tượng: Điều quan trọng là phải bảo vệ những thứ có giá trị của bạn an toàn, sẽ là khập khiễng nếu bạn cứ canh giữ lâu đài của mình cả ngày. Sử dụng máy ảnh mâm xôi pi, bạn có thể chụp nhanh vào đúng thời điểm. Hướng dẫn này sẽ giúp bạn quay video hoặc chụp ảnh

Lập trình hướng đối tượng: Tạo đối tượng Học / Phương pháp giảng dạy / Kỹ thuật sử dụng kéo: 5 bước

Lập trình hướng đối tượng: Tạo đối tượng Phương pháp học / dạy / kỹ thuật dùng kéo: Phương pháp học / dạy dành cho sinh viên mới làm quen với lập trình hướng đối tượng. Đây là một cách cho phép họ hình dung và nhìn thấy quá trình tạo ra các đối tượng từ các lớp. Phần: 1. Kéo (bất kỳ loại nào cũng được). 2. Mảnh giấy hoặc bìa cứng. 3. Điểm đánh dấu.

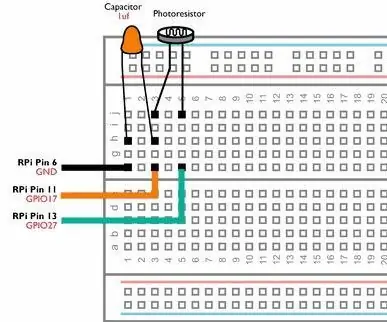

Mạch GPIO Raspberry Pi: Sử dụng cảm biến tương tự LDR mà không cần ADC (Bộ chuyển đổi tương tự sang kỹ thuật số): 4 bước

Mạch GPIO của Raspberry Pi: Sử dụng cảm biến tương tự LDR mà không cần ADC (Bộ chuyển đổi tương tự sang kỹ thuật số): Trong phần Hướng dẫn trước đây của chúng tôi, chúng tôi đã chỉ cho bạn cách bạn có thể liên kết các chân GPIO của Raspberry Pi với đèn LED và công tắc và cách chân GPIO có thể cao hoặc Thấp. Nhưng điều gì sẽ xảy ra nếu bạn muốn sử dụng Raspberry Pi của mình với cảm biến tương tự? Nếu chúng tôi muốn sử dụng

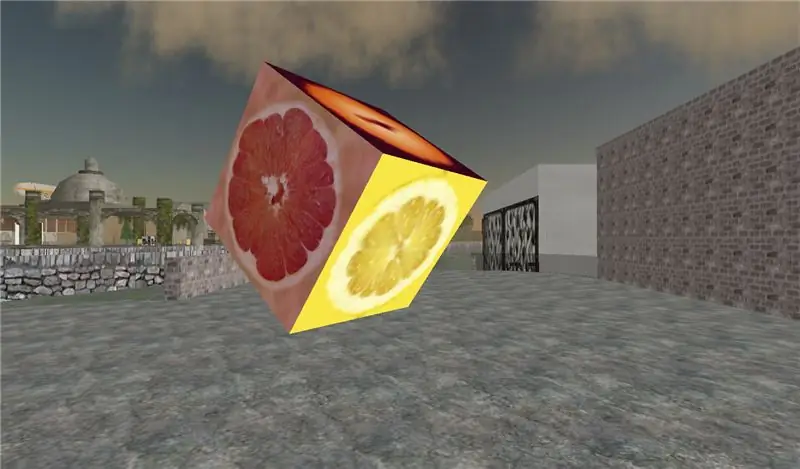

Cách áp dụng các họa tiết trên các bề mặt đối tượng riêng lẻ trong đời thứ hai: 7 bước

Cách áp dụng họa tiết trên các bề mặt đối tượng riêng lẻ trong Đời sống thứ hai: Trong Đời sống thứ hai, bạn có khả năng áp dụng nhiều kết cấu cho một đối tượng duy nhất. Quá trình này rất đơn giản và có thể cải thiện đáng kể sự xuất hiện của các công trình xây dựng của bạn